MyVLM:Personalizing VLMs for User-Specific Queries

MyVLM:Personalizing VLMs for User-Specific Queries

Abstract

大规模视觉语言模型(VLMs)在理解和生成视觉内容的文本描述方面展现出了卓越的能力

然而,这些模型缺乏对用户特定概念的理解

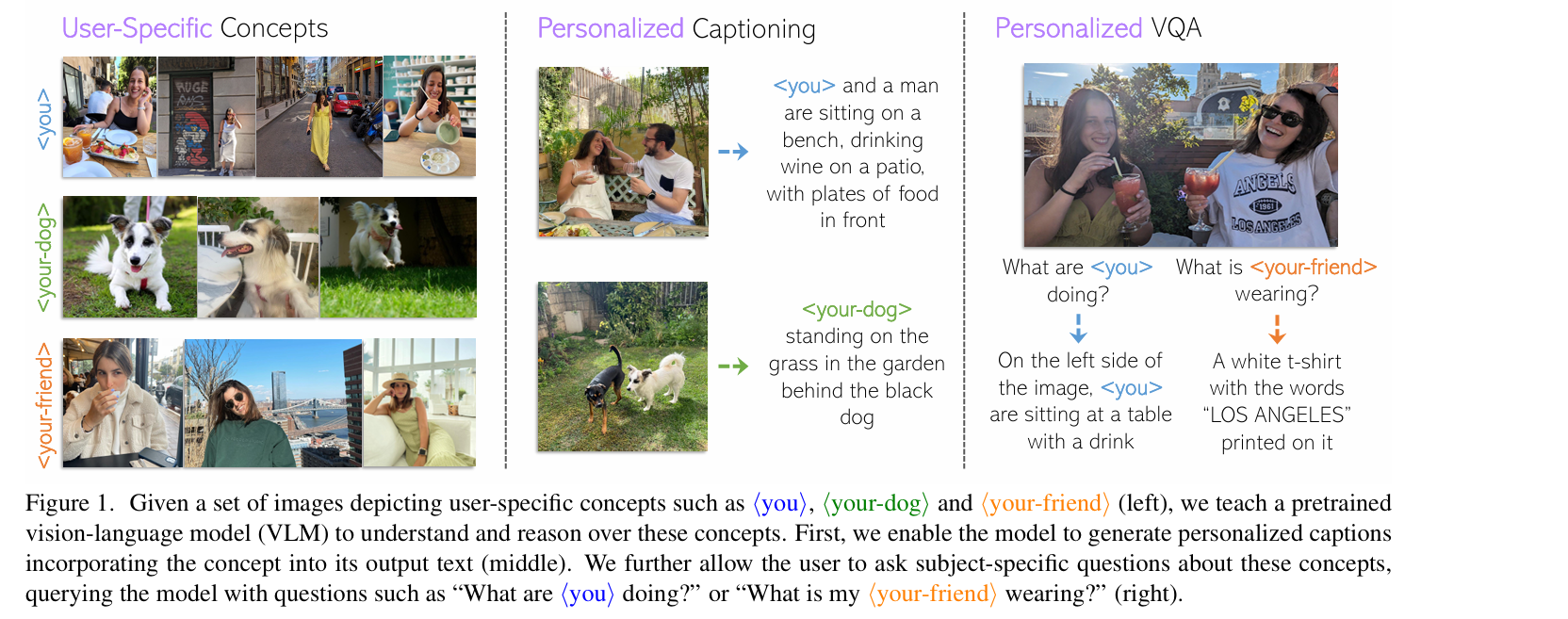

我们首次尝试个性化 VLMs,使其能够学习并推理用户提供的概念。例如:模型是否能够学习识别图像中的“你”,并描述你的行为,从而使模型能够反映你的个人经历和人际关系

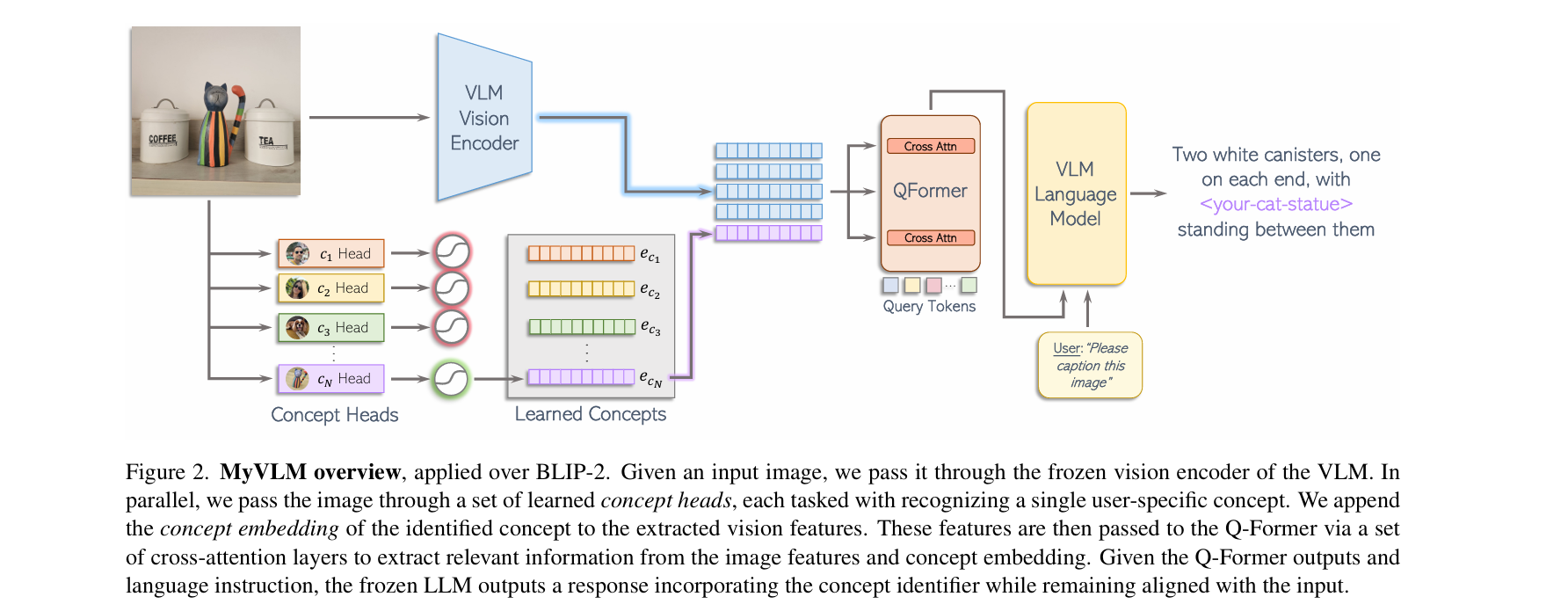

为了有效识别多样化的用户特定概念,我们通过外部概念头(concept heads)增强VLM,这些概念头作为模型的开关,使VLM能够识别给定图像中特定目标概念的存在

识别概念后,我们在VLM的中间特征空间中学习一个新的概念嵌入(concept embedding)

该嵌入的任务是引导语言模型自然地将目标概念整合到其生成的响应中

我们将该技术应用于BLIP-2和LLaVA以实现个性化图像描述,并进一步展示其在个性化视觉问答中的适用性

实验表明,我们的方法能够泛化到已学习概念的新图像,同时保持模型在无关输入上的行为不变

1. Introduction

大语言模型(LLMs)改变了人机交互方式,为用户提供了与文本信息交互的直观界面

通过视觉语言模型(VLMs)将视觉整合到LLMs中,进一步增强了这种交互,使这些模型能够”看到”并对视觉内容进行推理

然而当前的VLMs仅具备通用知识,缺乏对个体用户的个性化理解。例如,VLM可以轻松识别”一只狗”的图像,但无法理解图中描绘的是你个人的狗

这引发了一个有趣的问题:我们能否赋予这些模型理解和使用用户特定概念的能力,专门为你量身定制?通过个性化这些模型,我们可以提供更有意义的交互,更好地反映个人经历和人际关系

将个性化概念引入现有模型面临重大挑战:

- 尝试为每个用户微调这些模型计算成本高昂

- 容易发生灾难性遗忘

在 LLMs 的背景下,这促使开发了模型编辑技术,以高效地修改这些大模型。然而,这些方法仅专注于修改模型对特定用户查询的响应

个性化 VLM 需要深入理解其视觉和语言组件如何交互:VLM 要有效地响应视觉查询,不仅需要识别和提取相关的视觉元素,还需要在其生成的回答中有意义地表达这些信息

进一步增加个性化 VLM 复杂性的问题:预训练的 VLM 提取的视觉特征不够具有表现力,无法有效地区分语义上相似的对象

解决方法:我们提出了一种增强 VLM 的方法,即添加外部概念头(external heads),用于识别场景中的用户特定概念

这些概念头的信号被用于在视觉编码器的输出旁边添加特定的可学习向量

从某种意义上讲,这些可学习向量的任务是引导语言模型在生成的响应中准确地整合匹配的个性化词汇,使其与输入图像在上下文上保持一致

为了训练这个概念向量,我们使用一个小型图像集(3-5 张),其中每张图像都包含该概念,并配有带有个性化词汇的对应描述

然后优化概念嵌入,使得当给定训练集中的图像时,将概念的嵌入附加到视觉编码器的输出会导致VLM生成对应的个性化目标描述

为鼓励可学习嵌入与其他图像标记保持分布一致,我们对VLM分配给概念嵌入的注意力施加额外的正则化

我们的个性化技术MyVLM使用户能够个性化预训练的VLM,而无需修改原始权重,保留了模型的通用能力

聚焦于个性化图像描述,我们将MyVLM应用于BLIP-2和LLaVA,并进一步展示其在视觉问答中的适用性,如下图所示:

实验表明,MyVLM 能够有效整合和语境化个性化概念,包括特定对象和个人,仅需少量概念图像即可实现

此外,我们引入并评估了多种基线方法,突出了 MyVLM 在已学概念的新实例上的更优泛化能力

为评估这一新任务,我们引入一个新数据集,包含在各种情境中描绘的多个对象和个体,每个都有对应的个性化描述

2. Related Works

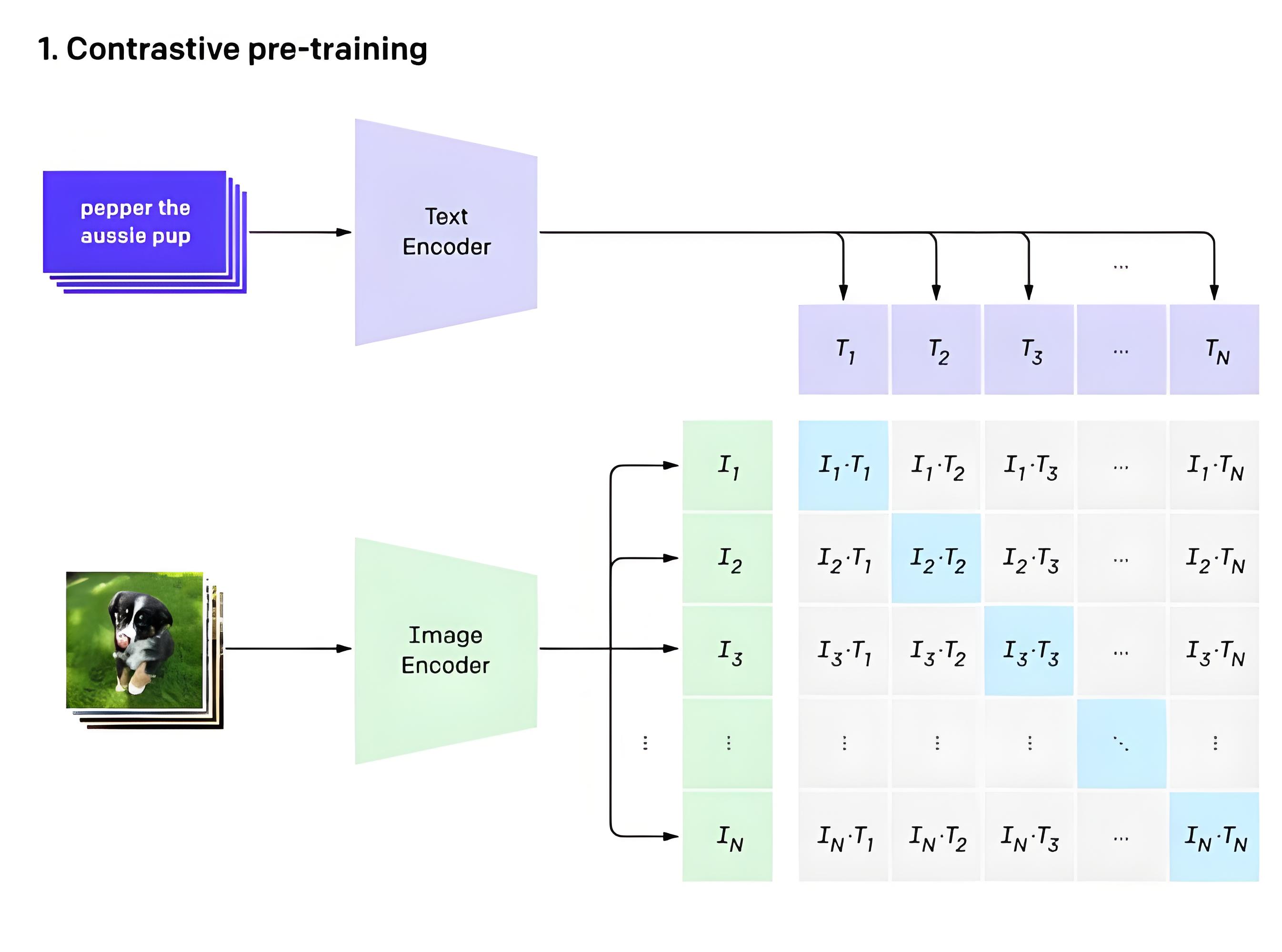

Vision-Language Models (VLMs)

大语言模型(LLMs)的显著进展激发了为其赋予视觉内容推理能力的努力

VLM研究的一个关键领域聚焦于利用冻结的LLMs在对齐图像和文本的统一模型中支持视觉和语言输入:

- Flamingo使用交叉注意力机制融合视觉和语言模态,同时保持视觉编码器和语言模型固定

- BLIP-2引入Q-Former transformer将对齐从固定视觉编码器提取的视觉特征与大语言模型结合

- LLaVA和MiniGPT-4采用指令调优的语言模型并从预训练的视觉编码器(如CLIP)提取视觉特征。具体而言,LLaVA使用简单的线性层将视觉特征映射到语言模型的输入空间

VLMs已被用于指导各种下游任务,如强化学习和图像生成

本工作中,我们聚焦于个性化VLMs,使其能够推理用户特定概念。我们的方法不修改VLM的原始权重,保留了其强大的视觉和语言先验

我们将该方法应用于BLIP-2和LLaVA,展示其作为适用于各种VLMs的通用框架的有效性

Personalization

在个性化任务中,我们的目标是调整给定模型以捕捉新的用户特定概念

个性化已在推荐系统和对象检索等一系列任务中探索:

- PALAVRA在文本编码器的输入空间中优化新词标记嵌入以表示新概念

- Yeh将其扩展用于视频中的概念检索

个性化在图像生成的背景下也被广泛研究。与我们的工作最相关的是基于反演的方法,其中优化嵌入以捕捉目标概念

另一研究方向聚焦于个性化图像描述模型:

- Park采用记忆网络存储用户的活跃词汇表,并利用其生成反映用户个人写作风格的描述

- Wang使用transformer融合视觉特征和编码用户特定关键词的文本特征。这些特征随后传递给预训练的语言模型以生成个性化描述。

个性化描述技术专注于生成特定的写作风格。相比之下,我们的目标是教会模型将新的用户特定概念整合到与给定图像对齐的个性化文本输出中

Model Editing

尽管现代机器学习系统在实现最先进性能方面表现出色,但其有效性在部署后可能减弱,导致幻觉和事实衰减

因此对模型编辑的需求日益增长,其目标是在最小化对其他输入性能影响的同时,高效修改模型行为

在语言模型的背景下,几种方法结合超网络预测特定输入的编辑或执行参数高效的模型调优

实现在单一模型中进行大量编辑:Hartvigsen等人在语言模型的中间特征空间中引入码本,存储先前学习的编辑。对于每个新编辑,向码本添加一个新键,并优化其对应值,使得语言模型为给定查询生成期望输出

最近,检索增强生成(RAG)也作为向LLMs注入知识的替代方法出现

我们的VLM个性化目标需要与模型编辑不同的方法:

- 模型编辑专注于对模型行为进行精确修改(例如将”法国的首都是什么?”与”巴黎”关联)

- 个性化要求模型适应概念的新图像,这些图像可能差异显著(例如在不同场景中识别个体)

此外,在教会模型新概念时,必须将概念与其周围环境分离,例如将个体与其穿着的衣服分开

VLM不仅需要识别概念,还需要在生成的响应中情境化它

3. Method

目标:通过教会视觉语言模型(VLM)生成聚焦于用户特定概念的个性化文本响应来扩展其能力

首先概述本工作中考虑的特定VLM模型家族,即BLIP-2和LLaVA。然后介绍我们的个性化技术MyVLM,并展示其在个性化描述和视觉问答中的应用

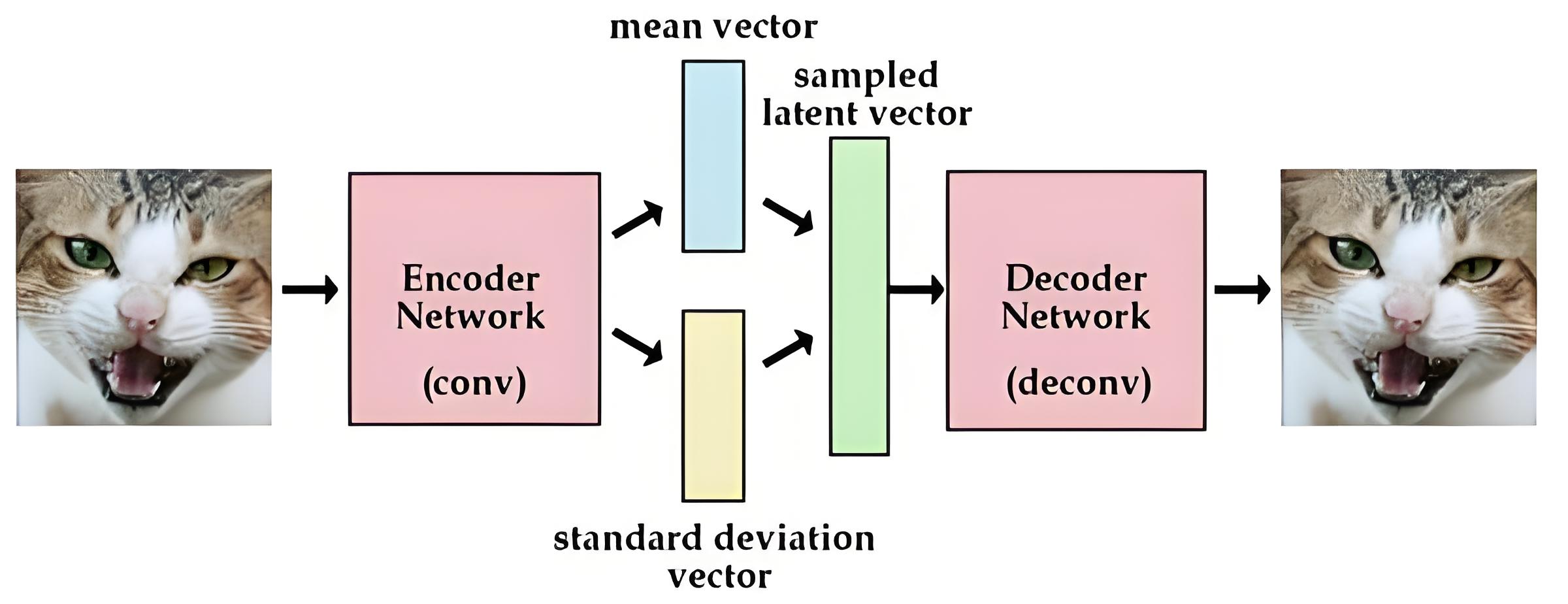

3.1. Preliminaries(预备知识)

BLIP-2

BLIP-2模型由Li等人提出,是一个围绕三个主要组件构建的VLM模型:

- 预训练的ViT-L/14视觉编码器

- 预训练的语言模型

- 可训练的查询变换器(Q-Former)模型,负责桥接视觉-语言模态间隙

Q-Former接收32个可学习查询标记作为输入,每个标记维度为d=768,由三种类型的层组成:自注意力层、交叉注意力层和前馈层

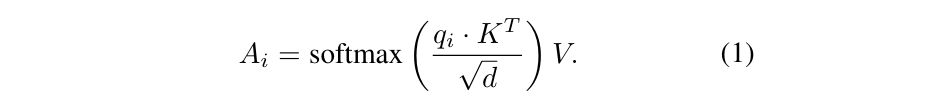

与我们的工作最相关的是交叉注意力层,每隔一个transformer块放置,这些块旨在捕捉提取的图像特征与可学习查询标记(以及我们学习的概念表示)之间的交互

在每个交叉注意力层,图像特征首先通过学习的线性投影投影到一组键(K)和值(V)。32个学习查询标记的中间表示同样投影到一组注意力查询q_i

对于每个查询q_i,然后按照以下公式计算这些表示的加权平均值:直观上,由softmax定义的概率表示从每个图像特征传递到每个查询标记的信息量

LLaVA

与BLIP类似,LLaVA试图将固定的视觉编码器与固定的语言模型连接起来,这里使用的是CLIP ViT-L/14和Vicuna模型

LLaVA采用更简单的架构,其中使用单个线性层将图像特征映射到语言模型的词标记嵌入空间。这个投影视觉标记序列随后直接馈送到语言模型,与编码的语言指令一起

3.2. MyVLM

我们的方法用于针对用户特定概念个性化视觉语言模型。为简单起见,我们描述应用于BLIP-2模型的MyVLM,随后讨论将MyVLM与LLaVA集成所需的调整

给定仅少量(约3-5张)特定概念的图像和包含概念标识符S_*的对应描述,我们的目标是通过增强VLM的能力,使其能够回答关于描绘概念的新图像的特定查询

我们的技术包含两个关键阶段:

- 识别给定场景中的概念

- 向语言模型传达关于概念的信息

为实现这一点,我们引入一个概念头,旨在识别图像中的个性化概念。然后使用学习的概念嵌入(代表对象或个体)来引导LLM将概念整合到其个性化文本响应中,如下图所示:

Recognizing

为使预训练的VLM能够推理个性化概念,我们必须首先识别它们在给定场景中的存在

直接的方法是考虑VLM视觉编码器的特征空间。然而,我们经验观察到冻结视觉编码器的特征空间表达能力不足,无法在视觉上区分目标概念与相似概念

虽然可以微调视觉编码器本身以更好地识别我们感兴趣的对象,但这可能会自然损害其强大的通用知识,并影响其提取关于整个图像信息的能力,这对于生成准确响应也至关重要

相反,我们用一组外部概念头增强VLM,每个头专用于识别我们希望教会模型的单个个性化概念。这些头使模型能够识别感兴趣的概念,而不妨碍其提供关于图像中描绘的整个场景的视觉信息的能力

由于这些头独立于VLM模型本身运行,我们可以支持任何专门的分类头来识别我们的目标概念

为识别用户特定对象,我们选择在预训练的CLIP模型提取的嵌入上训练简单的线性分类器;为生成针对特定个体的个性化输出,我们利用预训练的人脸识别网络作为额外的概念头

为每个概念定义单独的头提供了额外的灵活性,使用户能够自然地随时间扩展到更多概念

Communicating

在具备识别我们感兴趣概念的能力后,我们现在转向描述我们教会VLM传达关于目标概念响应的方法

在VLM的中间特征空间中学习单个概念嵌入向量代表概念。直观上,这个嵌入应引导语言模型生成包含概念标识符的文本响应,该标识符:

- 在上下文上正确

- 与提供的图像和语言指令对齐

为学习这个嵌入,使用一小部分描绘概念在不同情境下的图像,每张图像配有包含概念标识符的目标描述

对于标识符,我们遵循DreamBooth的惯例,在个性化对象输出时使用现有的、不常见的词,在个性化个体时使用短名称

通过直接优化找到概念嵌入e_,嵌入e_附加到从冻结视觉编码器提取的图像特征上,并通过交叉注意力层馈送到Q-Former网络

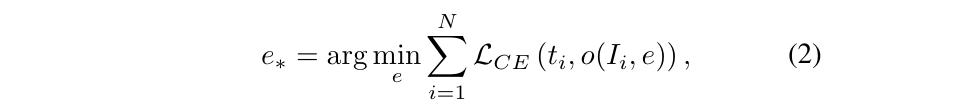

Q-Former的输出随后传递给冻结的语言模型,生成预测的图像描述。优化过程旨在最小化生成描述与提供的目标描述之间的标准交叉熵损失

优化可以定义为:

- 其中N是训练样本数,t_i代表第i个样本的目标描述,o(I_i,e)是给定概念嵌入e的第i个图像I_i生成的输出描述。在推理时,由我们的概念头识别的概念的嵌入同样附加到视觉编码器的输出

Improving Generalization

虽然上述方法允许生成个性化描述,但我们观察到直接将概念嵌入附加到图像特征可能导致语言模型生成不自然的描述

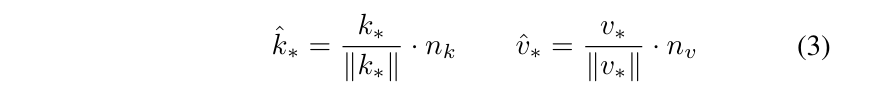

首先,在Q-Former的交叉注意力层中,我们观察到对应于概念嵌入的键(k_)和值(v_)的向量范数明显大于冻结图像特征的范数

在计算与Q-Former查询标记的交叉注意力之前,我们将k_和v_归一化以匹配原始键和值的平均范数,分别表示为n_k和n_v。嵌入的修改后的键和值由下式给出:

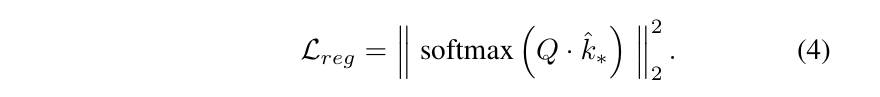

在Q-Former交叉注意力层计算的注意力权重(方程(1))中,概念标记倾向于主导注意力分布,导致查询标记不再有意义地关注图像标记

由于未能充分关注原始图像标记,相关视觉信息可能不再传递给语言模型,导致生成的描述与图像之间可能的不对齐

为鼓励所有标记间更平衡的注意力分布,我们对所有32个Q-Former查询标记分配给概念嵌入的注意力概率引入L2正则化。计算:

- 通过鼓励标记关注原始图像特征,我们发现输出更加连贯并与图像对齐

3.3. MyVLM over LLaVA

为将MyVLM应用于LLaVA,我们对上述方案进行以下调整:

- 将概念嵌入附加到线性投影的输出,而非直接附加到视觉编码器之后。我们发现这导致更快、更稳定的收敛

- 由于LLaVA不使用交叉注意力机制,我们省略了方程(3)中键和值的归一化。而是重新缩放概念嵌入,使其向量范数等于视觉编码器输出的[CLS]标记的范数

- 修改了方程(4)中基于注意力的正则化。应用L2正则化,鼓励从其他输入标记(包括语言标记和其他投影图像标记)向概念嵌入分配低注意力

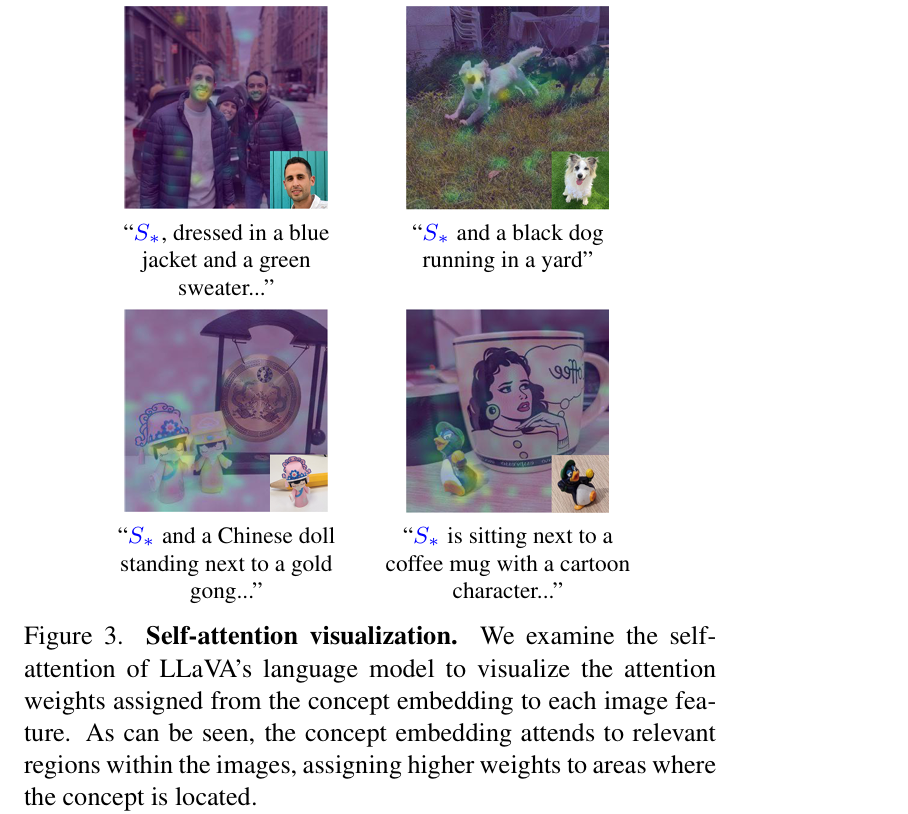

由于我们的概念嵌入作为输入与其它投影图像特征一起传递给语言模型,我们有一种自然的方式来调查学习的概念嵌入是否关注输入图像中的有意义区域

检查LLaVA语言模型的自注意力层,并可视化概念嵌入分配给每个图像块的注意力权重。如下图所示:进一步探索概念嵌入在注意力层中的行为可以为扩展MyVLM的能力提供更多见解

3.4. MyVLM for Additional Applications

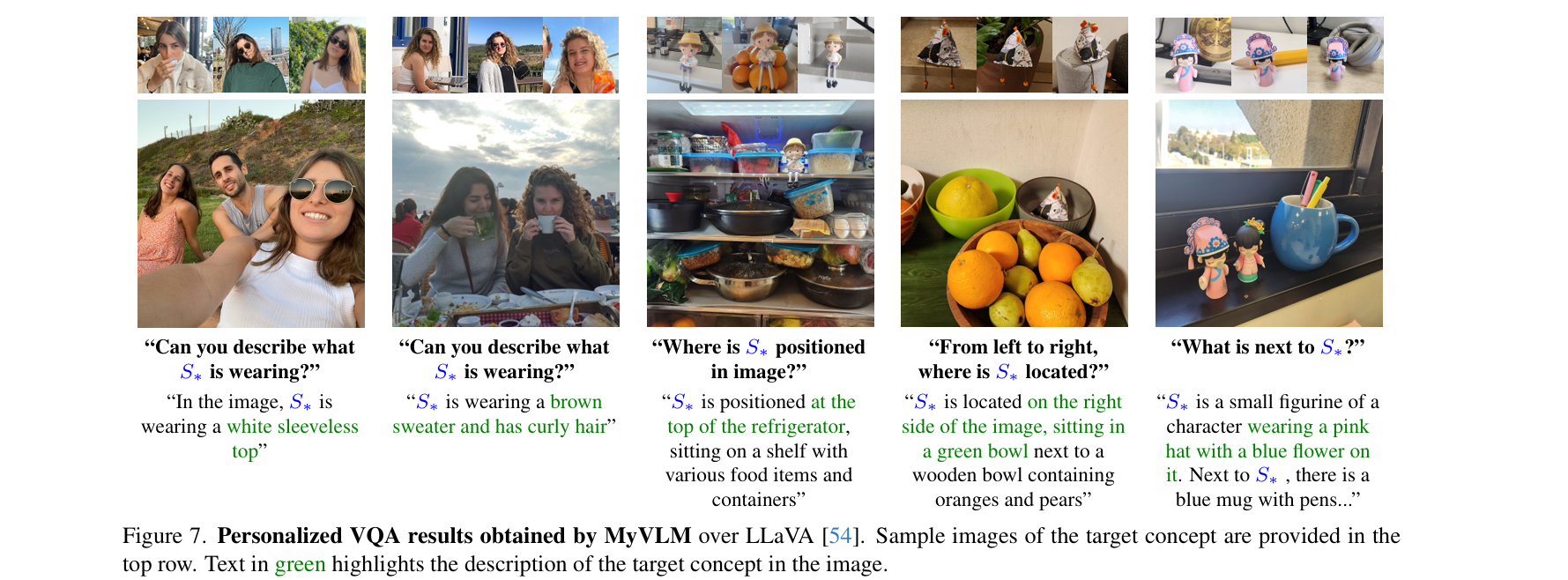

Personalized Vision Question-Answering

在将MyVLM应用于个性化视觉问答时,我们采用与上述方法相似的策略,但会调整用于定义目标函数的语言指令和输出内容

在个性化描述任务中,优化概念嵌入时传递给语言模型的指令是固定的。然而,对于视觉问答任务,我们希望模型能够泛化到用户可能对给定图像提出的任何问题

因此,我们扩展了优化过程中使用的指令和目标集合:定义了一组10个与目标概念相关的问题-答案对。例如,我们会提问”S∗是什么颜色的?”、”S∗在图像中的什么位置?”、”S∗穿着什么?”等

在每次优化步骤中,我们随机抽取一个问题-答案对用于当前步骤。通过针对目标概念的特定问题进行嵌入向量优化,该嵌入应该能更好地泛化到用户可能提出的新问题

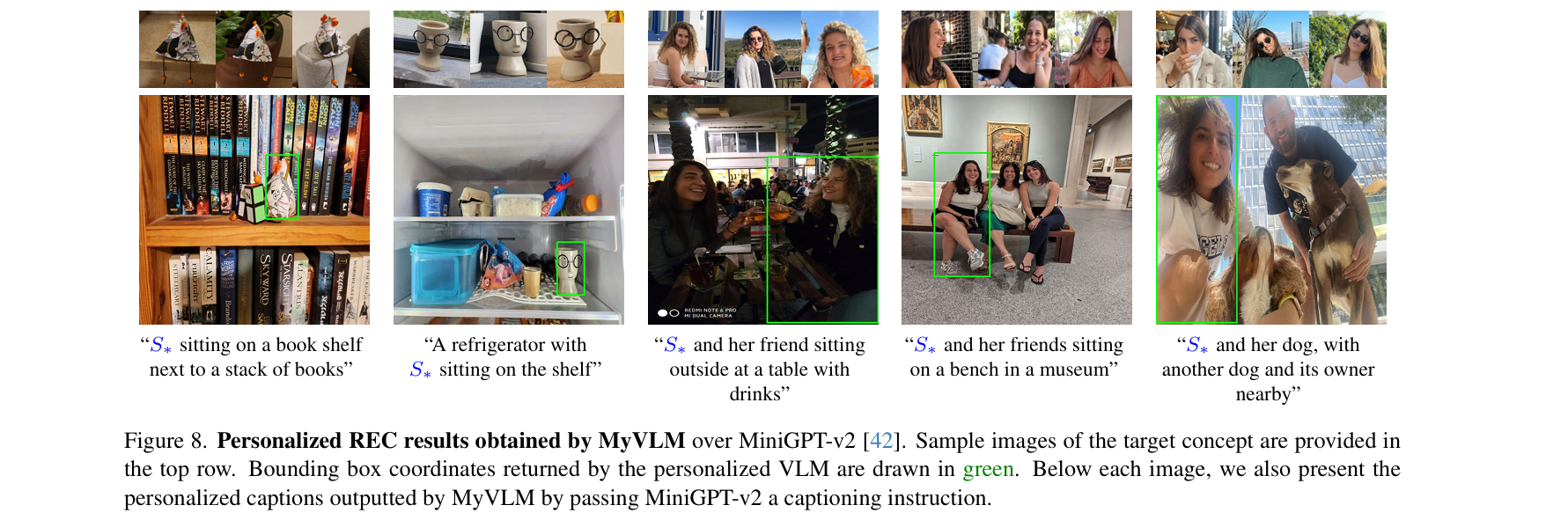

Personalized Referring Expression Comprehension

展示了MyVLM在另一个个性化任务中的应用:指代表达理解(REC),该任务需要在给定图像中定位目标主体

为此,我们使用了MiniGPT-v2,这是一个通过采用不同任务标识符来定义传递给语言模型的指令,从而自然处理各种视觉语言任务的VLM

由于MiniGPT-v2与LLaVA共享相同的架构,我们在学习概念嵌入时采用了相同的训练设置。为了优化概念嵌入,我们遵循与个性化描述相同的方案,并使用以下指令:”[caption] 请为这张包含S∗的图像生成描述”

在推理阶段,为了完成REC任务,将语言指令修改为:”[refer] 图像中的S∗”,这将返回目标主体在提供图像中的边界框坐标

这仅通过优化过程中的描述监督就能实现。这基于底层VLM解决多任务的固有能力,同时表明学习到的嵌入确实捕获了概念的语义表示,模型可以将其重用于不同任务

4. Experiments

Dataset

- 由于目前没有现成的VLM个性化数据集,我们为此任务引入了一个新数据集。该数据集分为两类:

- 物体:对于物体类别,我们整理了29个物体,包括各种玩具、雕像、杯子和宠物。每个概念收集了至少10张图像,展示主体在不同场景中与其他物体一起出现或置于背景下

- 人:对于人物类别,我们收集了16位年龄在25至80岁之间个体的图像。每位个体由至少15张图像代表,展示他们在不同场景、着装下的状态,有时与其他人在同一图像中出现。每张图像都配有包含概念标识符的对应个性化描述

Evaluation Metrics

- 重点定量评估个性化图像描述任务,因为该任务的数据更容易获取。从两个方面评估个性化描述:

- 测量召回率:验证概念标识符是否至少在生成的描述中出现一次。这评估了我们识别新图像中概念的能力,以及通过嵌入将概念纳入输出的能力

- 评估生成描述与输入图像和目标描述的一致性:对于两者,我们都将概念标识符替换为概念的类别

- 计算生成描述与输入图像之间的CLIPScore

- 其次计算句子相似度,即目标描述和生成描述的句子嵌入之间的平均余弦相似度

Baselines

由于目前没有专注于为目标概念生成个性化描述的现有基线,我们引入了几种替代方法:首先,我们使用冻结的VLM模型生成描述。然后,对于每个概念,我们使用GPT-4V定义三个描述概念的关键词,方法是向其提供概念的裁剪图像

对于人物,我们为每个概念指定一个关键词,即”男人”或”女人”。给定VLM生成的描述后,我们搜索描述中的关键词,如果找到,则用概念标识符替换该关键词

此外,我们引入了一个LLM引导的基线:给定冻结VLM生成的描述,我们将描述传递给语言模型,并要求其如果关键词之一存在于描述中,则将概念标识符整合到描述中

这种方法提供了更灵活的约束,允许语言模型更自由地将概念纳入描述

最后,我们将MyVLM与GPT-4V进行比较,向GPT-4V展示概念图像及其标识符,然后要求其对包含概念的新图像提问

4.1. Personalized Captioning

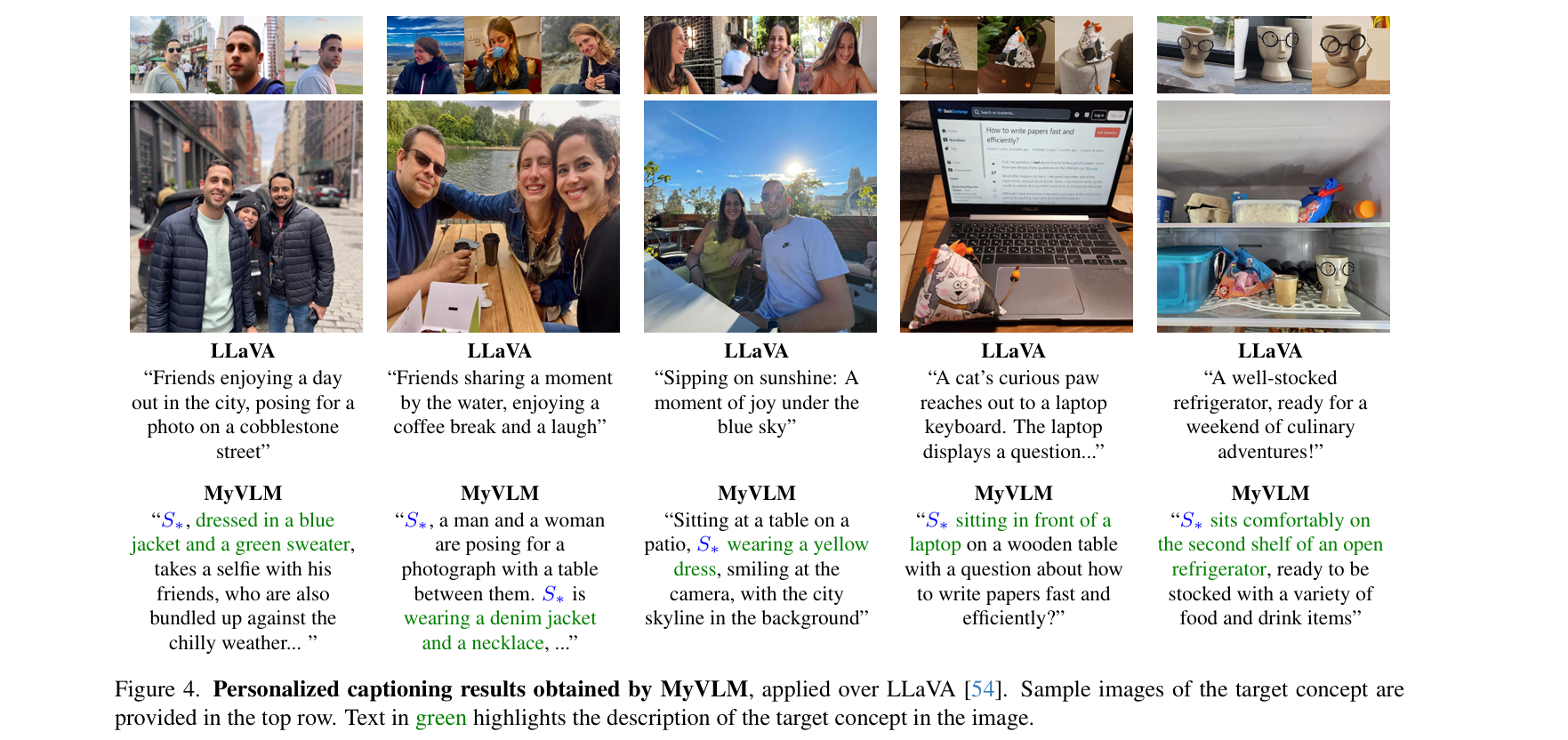

Qualitative Evaluation

- 下图展示了通过应用于LLaVA的方法生成的多个用户提供概念的个性化描述结果:

MyVLM生成的描述强调目标主体,而不是像原始VLM那样提供对整个场景的通用或抽象描述;此外,MyVLM自然地将概念标识符整合到生成的输出中,同时保持与输入图像的对齐

特别是在图像中出现多个个体的场景中,MyVLM在生成描述时成功聚焦于目标身份

当为用户提供的物体生成个性化描述时,这一点也很明显,这些物体被放置在场景中的众多其他物体之间。例如,在最右侧的列中,LLaVA生成的原始描述完全忽略了目标陶瓷杯,而我们的个性化描述准确地传达了它在图像中的位置

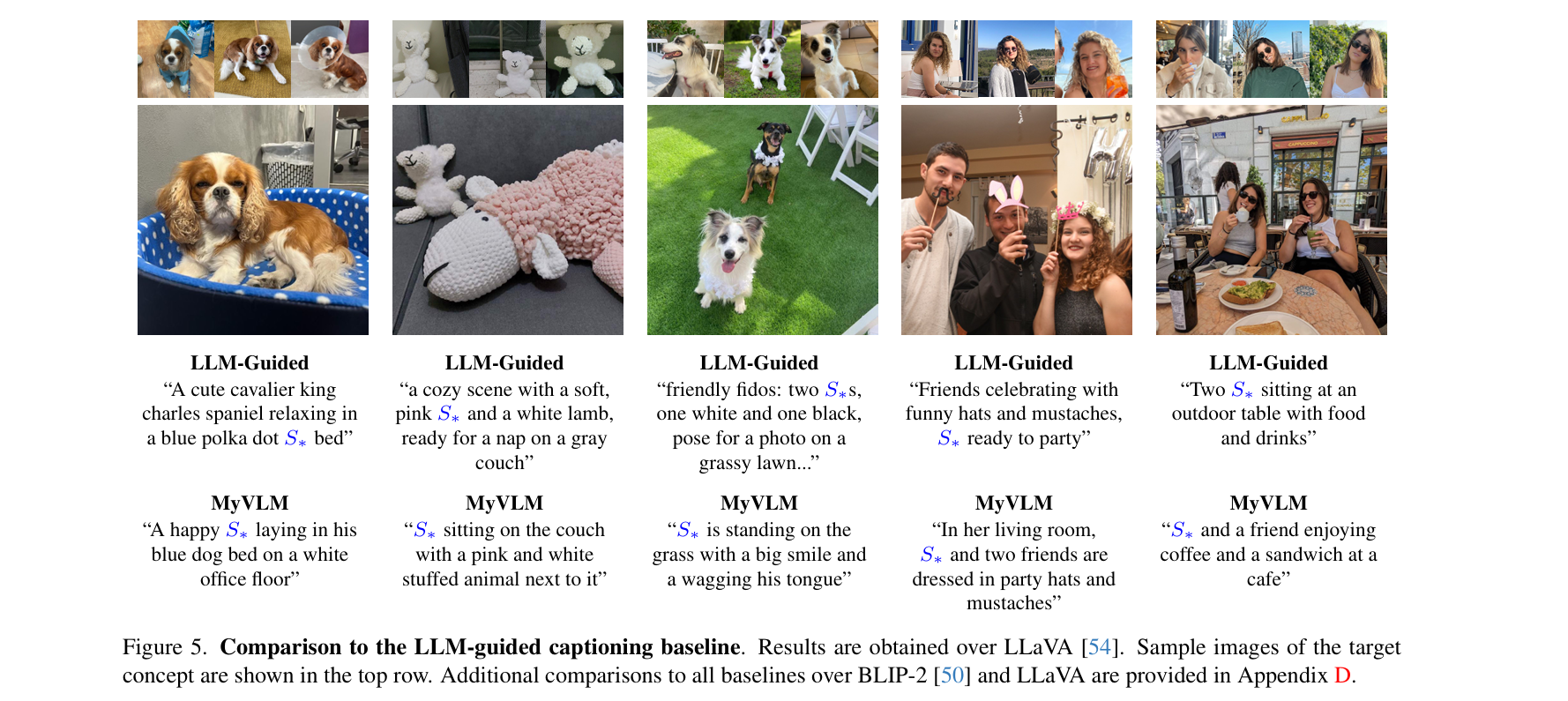

Qualitative Comparison

- 下图提供了与LLM引导基线的视觉比较:

当目标概念与共享相同关键词的另一个主体出现在同一图像中时,基线效果不佳,导致不自然的描述

相比之下,MyVLM成功识别目标主体,并生成准确将概念情境化于其周围环境的描述

重要的是,我们能在多个主体存在且概念仅占图像小部分区域时做到这一点

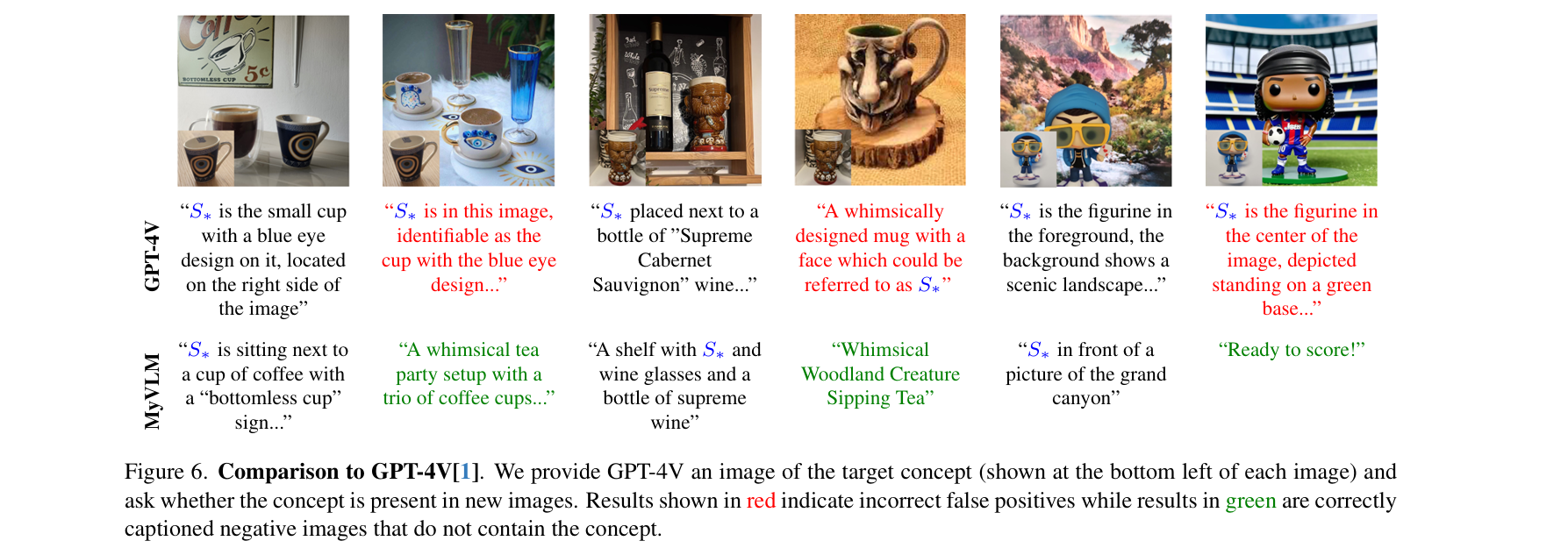

下图将我们的方法与GPT-4V进行比较:我们向其提供目标概念的图像及其标识符,然后要求其对可能包含概念的图像进行描述

如图所示,GPT-4V可以泛化到概念的新图像。然而,当呈现具有相似文本描述的反例图像时,GPT-4V会错误地将其识别为目标概念。相比之下,MyVLM能够区分这些困难的反例和目标概念

GPT-4V将视觉上不同但共享相似文本描述的对象错误识别的现象可能暗示其严重依赖对象的文本描述,即使向其提供了对象的图像

这强调了学习专用嵌入来表示我们的概念的优势,而不是仅仅依赖自然语言,因为用自然语言描述我们的确切目标概念可能具有挑战性

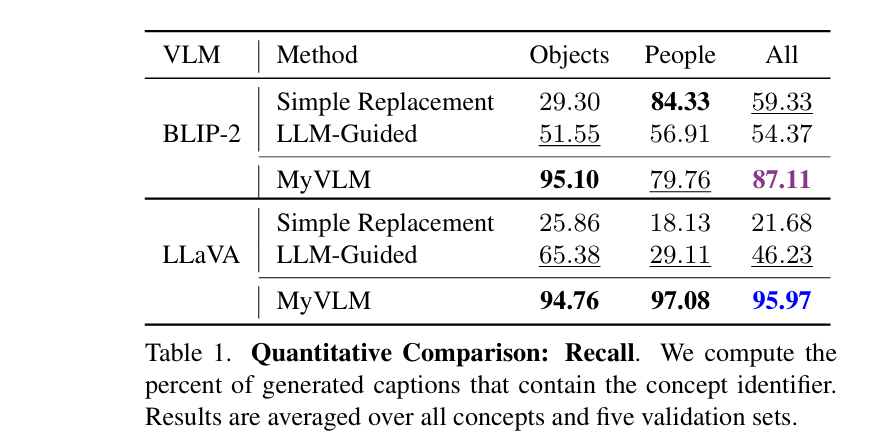

Quantitative Comparison

现在转向定量比较MyVLM与替代基线。为提供更大的验证样本量,我们对构建的数据集进行无替换的bootstrap采样

对于每个概念,我们随机抽取五个不同的训练集,每个包含四张图像,并将剩余图像作为对应的验证集。然后,我们在每个训练集上训练MyVLM,并为所有验证图像生成描述

首先测量每个基线在生成描述中纳入概念标识符的能力,结果如下表展示:

可以看到,对于用户特定物体,简单地尝试通过封闭的关键词集将概念标识符插入描述中是无效的,与MyVLM相比,召回率存在显著差距

虽然引入外部语言模型大大提高了召回率,但MyVLM在使用BLIP-2时仍比LLM引导方法高出44%,在使用LLaVA时高出30%

在考虑人物时,尽管关键词替换基线和MyVLM在应用于BLIP时获得可比较的结果,但MyVLM在应用于LLaVA时显著优于两个基线

与LLaVA的巨大差距似乎源于LLaVA生成的抽象描述,而BLIP-2倾向于生成更可能包含预定义关键词的简单描述

这突显了MyVLM对不同VLM模型的鲁棒性,而手工制作的基线严重依赖底层VLM的描述风格

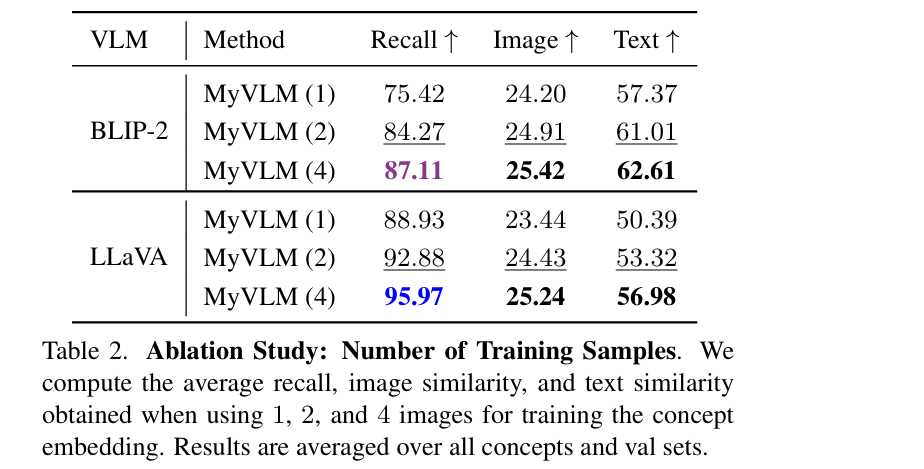

研究当使用4张、2张和仅1张图像训练概念嵌入时MyVLM的性能,我们在相同的验证集上评估所有模型。结果在所有45个概念上平均,结果如下图所示:

就召回率而言,BLIP-2和LLaVA的结果随着添加更多训练样本而持续改进。观察到即使使用单个样本训练,MyVLM仍以显著优势优于所有基线

计算我们的个性化描述与(1)输入图像和(2)目标描述之间的平均相似度,添加更多训练样本提高了图像相似度和文本相似度,表明泛化能力增强

这进一步突显了MyVLM在生成个性化描述方面的有效性,即使在具有挑战性的少样本设置和跨多个VLM框架中也是如此

4.2.My VLM fo rAdditional Applications

Personalized Visual Question-Answering

- 首先,我们展示MyVLM可用于个性化视觉问答。下图中我们展示了跨多个用户特定概念的结果:

MyVLM正确回答了与目标概念相关的问题,即使在包含多个个体的场景中(第一和第二列),以及在主体仅占图像小区域的场景中(第三和第四列)

MyVLM能够忠实捕获与目标概念相关的独特特征,使其能够在新场景中正确识别和定位概念

Personalized Referring Expression Comprehension

- 下图展示了通过MyVLM使用MiniGPT-v2实现的个性化指代表达理解(REC)和描述结果:

MyVLM不仅能生成个性化描述,还能在没有任何直接监督定位任务的情况下精确定位图像中的概念

MiniGPT-v2通过不同任务标识符适应多任务的能力,使得MyVLM能够以最小修改自然扩展到其他个性化应用

5.Limitations

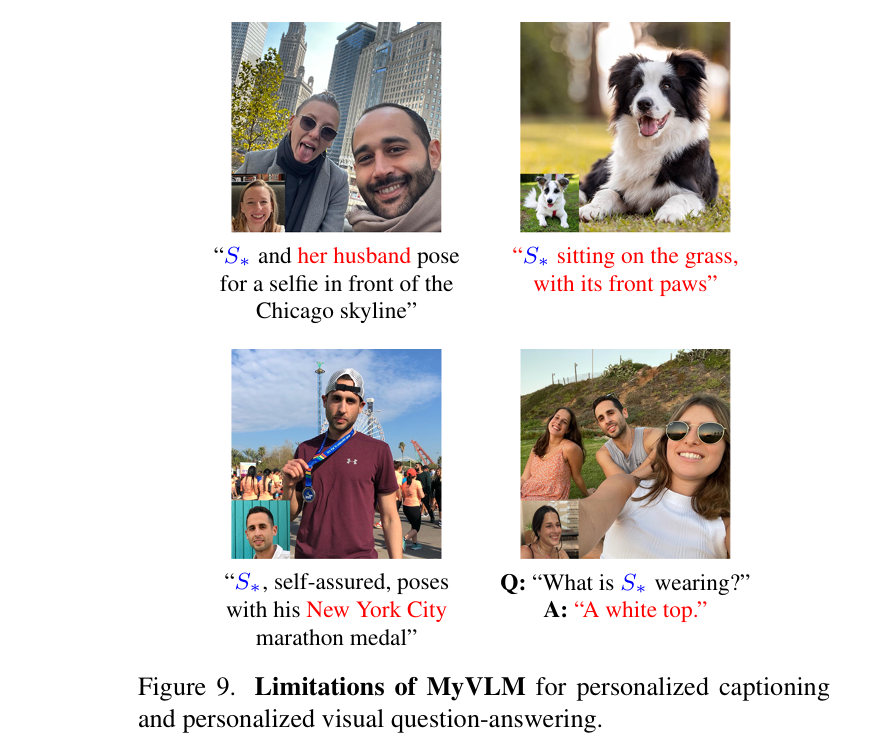

MyVLM为用户提供了与现有视觉语言模型创建更个性化交互的能力。然而,有几个局限性需要考虑:

- 我们对VLM的依赖使我们暴露于其固有偏见。例如,当前的VLMs通常将包含一男一女的图像归类为夫妻或配偶。这可能导致MyVLM在生成个性化描述时做出不准确的假设

- MyVLM依赖于概念头的质量。未能识别目标概念或错误识别无关主体可能导致不正确响应。然而,我们的概念头能很好地泛化到新图像,并且开放集识别技术的进一步发展可以纳入我们的方法,提高鲁棒性

尽管我们引入了各种机制来改进泛化,但仍可能存在训练期间所见上下文的泄漏。例如,如果在描绘一个人在纽约的图像上训练,MyVLM可能会错误地将”纽约”纳入新描述中

进一步探索正则化技术,特别是在VLM的注意力机制中,可能有助于减轻这种泄漏

对于个性化VQA,MyVLM可能在包含许多个体的图像中难以区分目标概念

此外,MyVLM似乎在训练期间遇到的问题上表现更好。进一步探索用于学习概念嵌入的增强和数据可能有助于解决这些更具挑战性的场景,下图说明了局限性:

6. Conclusions

在本文中,我们引入了视觉语言个性化的概念,使VLMs能够理解和推理用户特定概念,如独特物体和个体

作为这一努力的第一个步骤,我们提出了MyVLM,专注于个性化描述和VQA。仅给定概念的少量图像,我们通过一组模块化概念头增强冻结的VLM,使其能够识别用户特定概念

然后,我们在VLM的中间特征空间中训练一个嵌入向量,其任务是引导语言模型以自然和上下文准确的方式将概念纳入生成的响应中

DeepSeek要点总结

MyVLM论文核心总结

一、研究背景与动机

- 问题:现有视觉语言模型(VLMs)缺乏对用户特定概念(如个人物品/人物)的个性化理解能力

- 挑战:

- 直接微调会导致灾难性遗忘

- 视觉特征区分度不足

- 需同时实现概念识别与自然语言整合

二、核心创新点

双阶段架构:

- 概念识别:引入外部概念头(Concept Heads)

- 物体:基于CLIP的线性分类器

- 人物:基于人脸识别模型

- 概念传达:学习中间特征空间的概念嵌入(Concept Embedding)

- 概念识别:引入外部概念头(Concept Heads)

关键技术:

- 注意力归一化:平衡概念嵌入与原始特征的注意力权重

- 正则化策略:L2正则约束注意力分布

- 多任务适配:统一框架支持Captioning/VQA/REC等任务

核心优势:

- 不修改原始模型参数,保留通用能力

- 仅需3-5张样本即可学习新概念

- 支持多概念共存(模块化概念头设计)

三、实验验证

数据集:

- 新建MyVLM数据集(29个物体+16个人物,共680张图像)

- 每个概念包含多场景/多姿态样本

基线对比:

- 显著优于关键词替换/GPT-4V/OpenFlamingo等基线

- BLIP-2上物体召回率95.1%,LLaVA人物召回率97.08%

关键结果:

- 少样本学习:仅需1张样本即可达到75%+召回率

- 多任务泛化:同一嵌入支持Captioning/VQA/REC

- 注意力可视化:概念嵌入能聚焦目标区域

四、应用场景

个性化图像描述:

- 在复杂场景中准确描述用户指定对象

- 示例:从”杯子” → “你的星巴克纪念杯”

视觉问答:

- 回答关于特定对象的属性问题

- 示例:”你的狗在图像中穿什么?”

指代表达理解:

- 零样本定位用户指定对象

- 示例:在冰箱图像中定位”孩子的玩具”

五、局限性

- 依赖底层VLM的偏见(如性别/关系推断)

- 多人物场景下区分能力受限

- 存在上下文泄漏风险(可能关联训练场景特征)

六、创新价值

- 方法论:首次系统解决VLM个性化问题

- 工程价值:即插即用框架适配多种主流VLM(BLIP-2/LLaVA/MiniGPT-v2)

- 社会价值:推动个性化AI助手发展,增强人机交互自然性

七、资源开放

- 项目主页:https://snap-research.github.io/MyVLM/

- 代码与数据集:物体数据集已开源